Visibilité des données de réponse rapide

Les systèmes d'IA générative traitent des entrées en langage naturel pouvant contenir des informations sensibles.

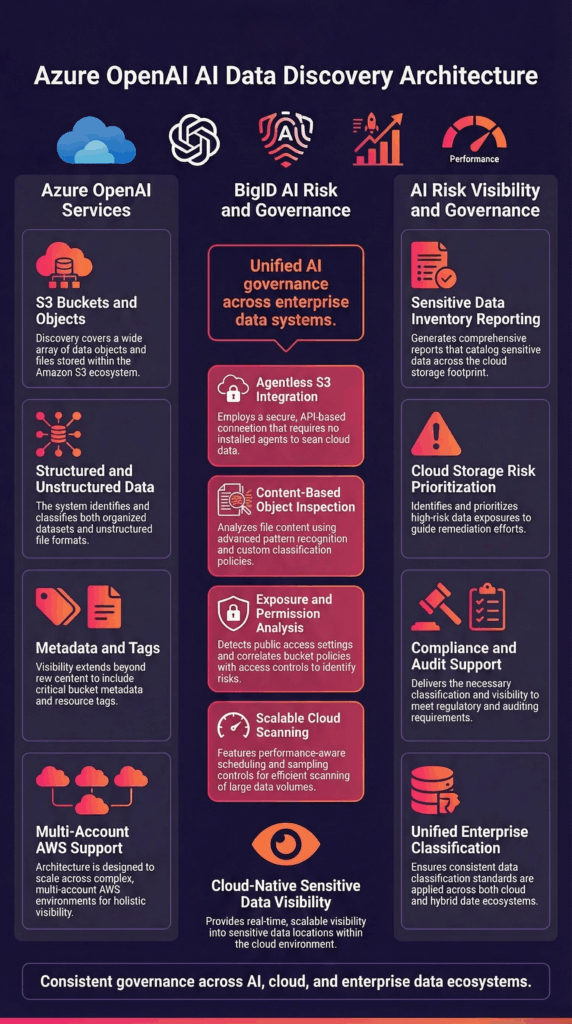

BigID permet aux organisations de :

- Identifier les données réglementées dans les invites

- Détecter les informations sensibles dans les résultats générés

- Surveiller les tendances d'utilisation des données d'IA

- Aligner les interactions de l'IA avec les politiques de l'entreprise

Cela réduit le risque de divulgation involontaire.