L'IA évolue rapidement. Les risques évoluent également plus vite. Les organisations adoptent l'IA pour stimuler l'innovation, l'efficacité et l'avantage concurrentiel. Mais à mesure que son déploiement s'accélère, hybride et multicloud environnements, une vérité devient douloureusement claire : Les risques liés à l’IA dépassent ceux liés à la gouvernance.

Selon le Rapport 2025 de BigID sur les risques et l'état de préparation à l'IA, plus de 93% des organisations manquent de confiance totale dans leur capacité à sécuriser les données générées par l'IA. Près de la moitié d'entre eux ont aucun contrôle de sécurité formel de l'IA en place, et juste 6.4% rapporte une visibilité complète sur la manière dont leurs modèles interagissent avec les données sensibles.

Il ne s'agit pas d'un manque de préparation, mais d'une exposition.

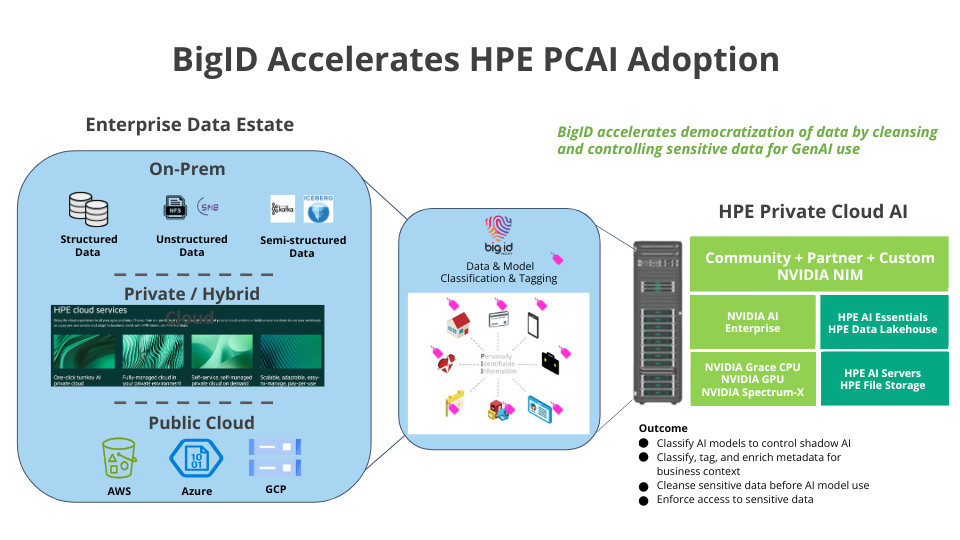

Chez BigID, nous croyons Une IA fiable commence par des données fiables. Et maintenant, cette conviction est soutenue par l'action : BigID a été certifié par Hewlett Packard Enterprise (HPE) pour son programme de partenariat Unleash AI, renforçant ainsi notre alliance stratégique pour apporter intelligence des données pour IA du cloud privé HPE (PCAI).

Élargissement de notre alliance avec HPE

L'IA du cloud privé HPE est conçue pour prendre en charge une infrastructure d'IA sécurisée et évolutive. BigID alimente la couche de données en contexte, contrôle et confiance.

En tant que partenaire certifié du programme Unleash AI, BigID offre intelligence des données intégrée, application des politiques et gestion de la posture de risque dans tous les environnements PCAI. Ensemble, nous fournissons les éléments de base permettant aux entreprises de déployer l'IA de manière sûre, sécurisée et responsable, en s'appuyant sur des données exploitables.

Avec BigID sur HPE Private Cloud AI, les organisations peuvent :

- Découvrir et classer données structurées et non structurées utilisées dans les pipelines d'IA

- Modèles d'étiquetage et de gouvernance, des intégrations et des bases de données vectorielles provenant de plateformes telles que Hugging Face et SageMaker

- Appliquer les politiques d'accès et empêcher l'utilisation surexposée ou non autorisée des ressources d'IA

- Automatiser les flux de travail de confidentialité pour aider à répondre aux exigences de conformité telles que GDPR, CPRAet RMF de l'IA du NIST

- Enrichir les métadonnées à l'ingestion pour améliorer la transparence, la précision et l'explicabilité du modèle

- Prolonger le DSPM dans les environnements périphériques, centraux et cloud

Il ne s'agit pas seulement de visibilité. Il s'agit d'informations exploitables à chaque étape du cycle de vie de l'IA.

Pourquoi l'IA de confiance est importante aujourd'hui

Le rapport 2025 sur les risques liés à l'IA révèle que :

- 69,5% des organisations citent les fuites de données alimentées par l'IA comme leur principale préoccupation en matière de sécurité

- 80.2% déclare qu'ils ne sont pas préparés à la conformité réglementaire de l'IA

- Seulement 6,4% des entreprises ont une visibilité et un contrôle complets sur le comportement des modèles d'IA et les interactions avec les données

En bref : le déficit de gouvernance n’est pas hypothétique : c’est le plus grand risque pour l’adoption de l’IA.

Les organisations ne peuvent plus se permettre de considérer les risques liés à l'IA comme une considération secondaire. Sans visibilité sur la manière dont les modèles utilisent et interagissent avec les données sensibles, les systèmes d'IA deviennent par défaut peu fiables. IA de l'ombre, exposition aux données non structurées, et les violations de conformité ne sont pas théoriques, elles se produisent maintenant.

BigID aide les entreprises à combler ce fossé. De l'automatisation de la détection des risques à l'application des politiques dans les workflows d'IA, nous permettons aux organisations de mettre en œuvre la confiance à grande échelle.

Ouvrir la voie à une IA de confiance

Avec cette certification de HPE, BigID renforce son rôle de leader dans gouvernance de l'IA centrée sur les données.

BigID va au-delà de l'étiquetage, nous connectons les points entre les données, les métadonnées et les ressources d'IA pour obtenir de meilleurs résultats :

- Réduire les risques

- Améliorer la qualité du modèle

- Accélérer l'adoption de l'IA sécurisée

- Se conformer aux cadres mondiaux en constante évolution tels que Loi européenne sur l'IA et NIST AI RMF

- Construire des systèmes d’IA responsables, transparents et résilients

La fiabilité de l'IA dépend des données sur lesquelles elle repose. Avec BigID et HPE, les entreprises déploient une infrastructure d'IA sécurisée et une intelligence des données pour accélérer leurs résultats de manière responsable.

Prêt à commencer ?

- Rencontrez l'équipe BigID à HPE Discover 2025 à Las Vegas, du 23 au 26 juin

- Réservez une démo pour voir BigID + PCAI en action

- Téléchargez le rapport sur les risques et l'état de préparation de l'IA

- Explorez la solution complète