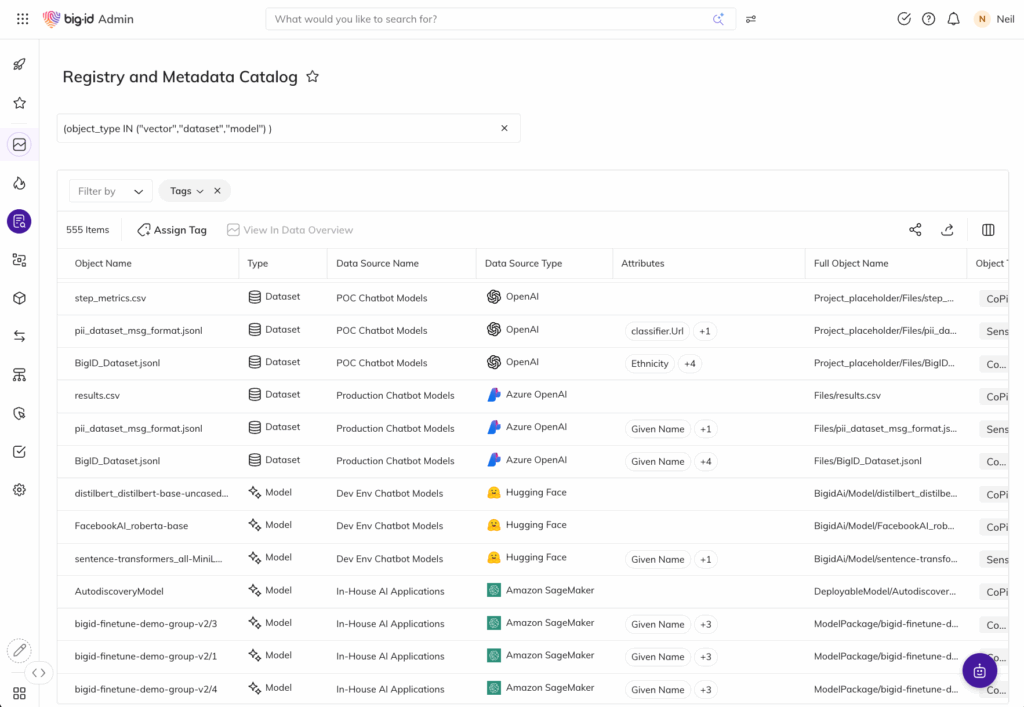

Découvrir et inventorier les ressources de l'IA

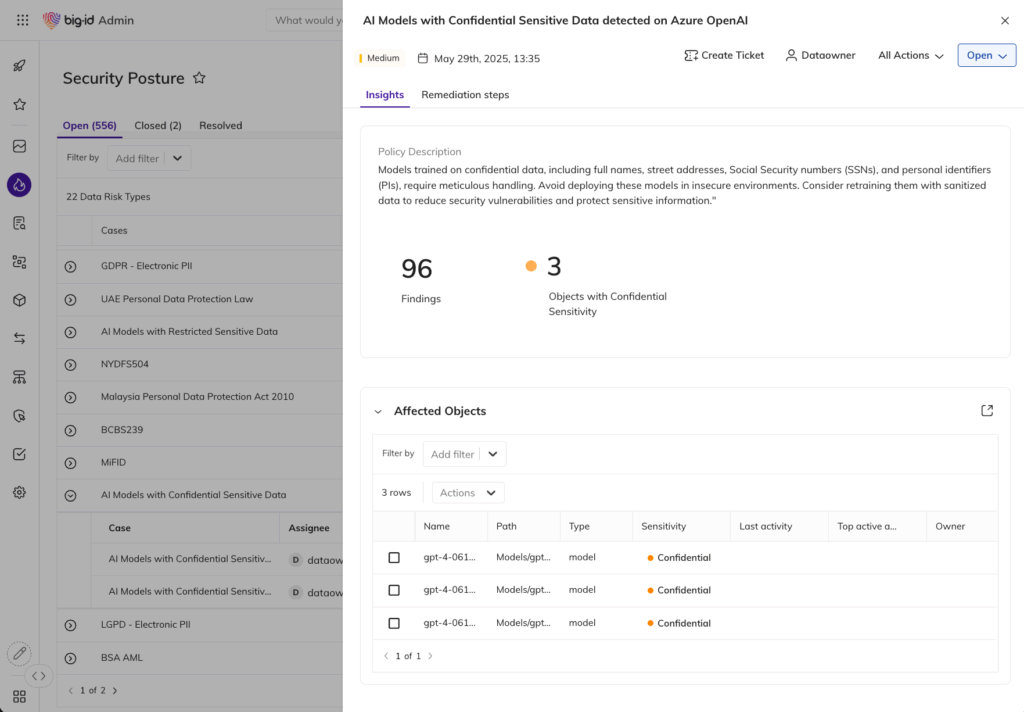

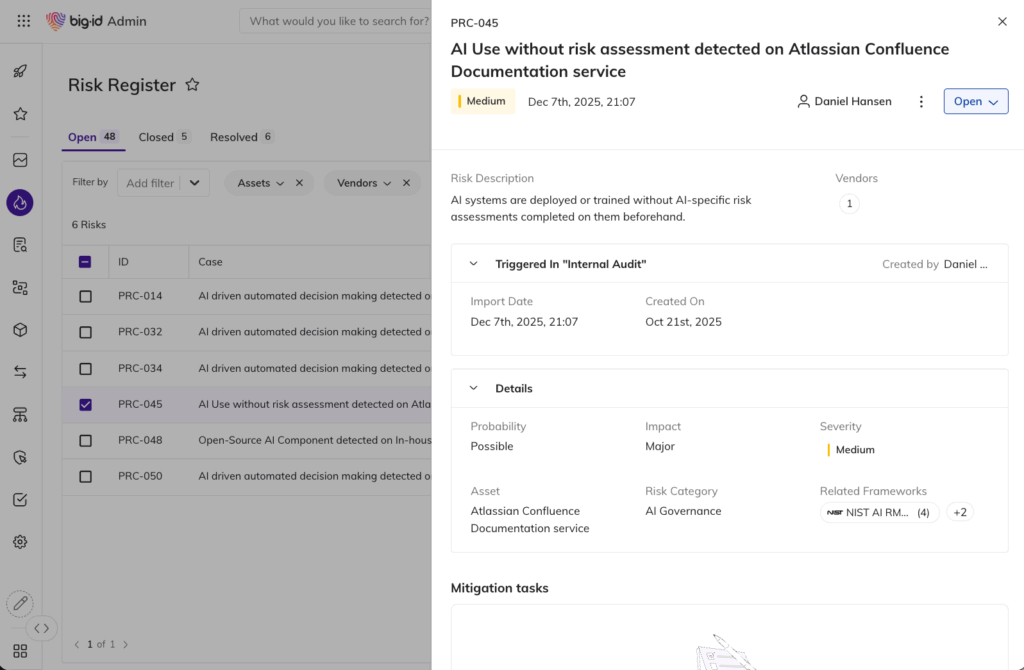

Découvrir et inventorier automatiquement les modèles d'IA, les agents, les ensembles de données, les bases de données vectorielles, les invites et l'IA tierce — y compris l'IA non autorisée et l'IA fantôme — afin d'éliminer les angles morts et de révéler les risques cachés.