KI-Agenten sind keine experimentellen Werkzeuge mehr, die auf Innovationslabore beschränkt sind. Sie sind bereits in Unternehmensumgebungen integriert – zum Lesen von Dateien, zum Beantworten von Tickets, Bereitstellungszugriff, Erstellung von Berichten und Einleitung von Sanierung Maßnahmen in kritischen Systemen. Ihre Einführung beschleunigt sich, weil sie Reibungsverluste reduzieren und Entscheidungsprozesse in großem Umfang automatisieren.

Viele Organisationen setzen diese Agenten jedoch unter der riskanten Annahme ein, dass bestehende IAM-Kontrollen, Modellsicherheit oder übergeordnete KI-Governance-Frameworks ausreichend seien. Zwar bleiben diese Kontrollen notwendig, sind aber für autonome Systeme, die selbstständig denken, handeln und kontinuierlich auf sensible Daten zugreifen und diese übertragen können, grundlegend unvollständig.

KI-Agenten sind nicht nur Modelle. Sie sind operative Akteure. Und Akteure, die in Maschinengeschwindigkeit agieren und permanenten Zugriff auf Unternehmensdaten haben, erfordern eine neue Sicherheitsdisziplin – eine, die auf Daten basiert, nicht nur auf Identität oder Infrastruktur. Dies ist die Grundlage für Haltungsmanagement für KI-Agenten.

Autonome Agenten als unsichtbare Insider

Sicherheitsteams sind im Umgang mit menschlichen Risiken erfahren. Sie verfolgen Benutzer, Rollen, Berechtigungen und Aktivitäten, um zu verstehen, wer worauf Zugriff hat und warum. Dieses Modell stößt jedoch an seine Grenzen, wenn es auf KI-Agenten angewendet wird.

Agenten melden sich nicht interaktiv an, fordern keine wiederholten Zugriffsrechte an und stoßen bei der Ausführung auf keine Einschränkungen. Nach der Bereitstellung arbeiten viele kontinuierlich mit Dienstkonten, OAuth-Anwendungen oder API-Schlüsseln – oft außerhalb herkömmlicher Identitätsprüfungen. Mit der Zeit fungieren sie als dauerhaft privilegierte Insider.

Diese Herausforderung wird oft als eine KI-Governance Problem, aber im Kern ist es ein Datensicherheitsproblem. Das Hauptrisiko geht nicht vom Agenten selbst aus, sondern von den sensiblen, regulierten und geschäftskritischen Daten, auf die er zugreifen und mit denen er Aktionen ausführen kann.

Definition des Haltungsmanagements von KI-Agenten

Das KI-Agenten-Statusmanagement umfasst die kontinuierliche Transparenz, Kontrolle und Steuerung der Zugriffsrechte, Entscheidungen und Aktionen von KI-Agenten in Unternehmensdaten. Es erweitert das Sicherheitsstatusmanagement auf autonome Akteure, deren Verhalten zum Zeitpunkt der Bereitstellung nicht vollständig vorhersehbar ist.

In der Praxis ermöglicht es Sicherheitsverantwortlichen, Fragen zu beantworten, die identitäts- oder modellzentrierte Ansätze nicht zuverlässig beantworten können:

Auf welche Daten kann dieser Agent zugreifen und welche Daten nutzt er tatsächlich? Welche Maßnahmen kann es mit diesen Daten ergreifen? Stimmt sein Verhalten noch mit den Richtlinien und Absichten überein? Und wenn etwas schiefgeht, lassen sich seine Aktionen erklären, einschränken oder stoppen?

Ohne Transparenz und Kontrolle auf Datenebene bleiben diese Fragen unbeantwortet – unabhängig davon, wie gut Identitäten verwaltet oder Modelle gesteuert werden.

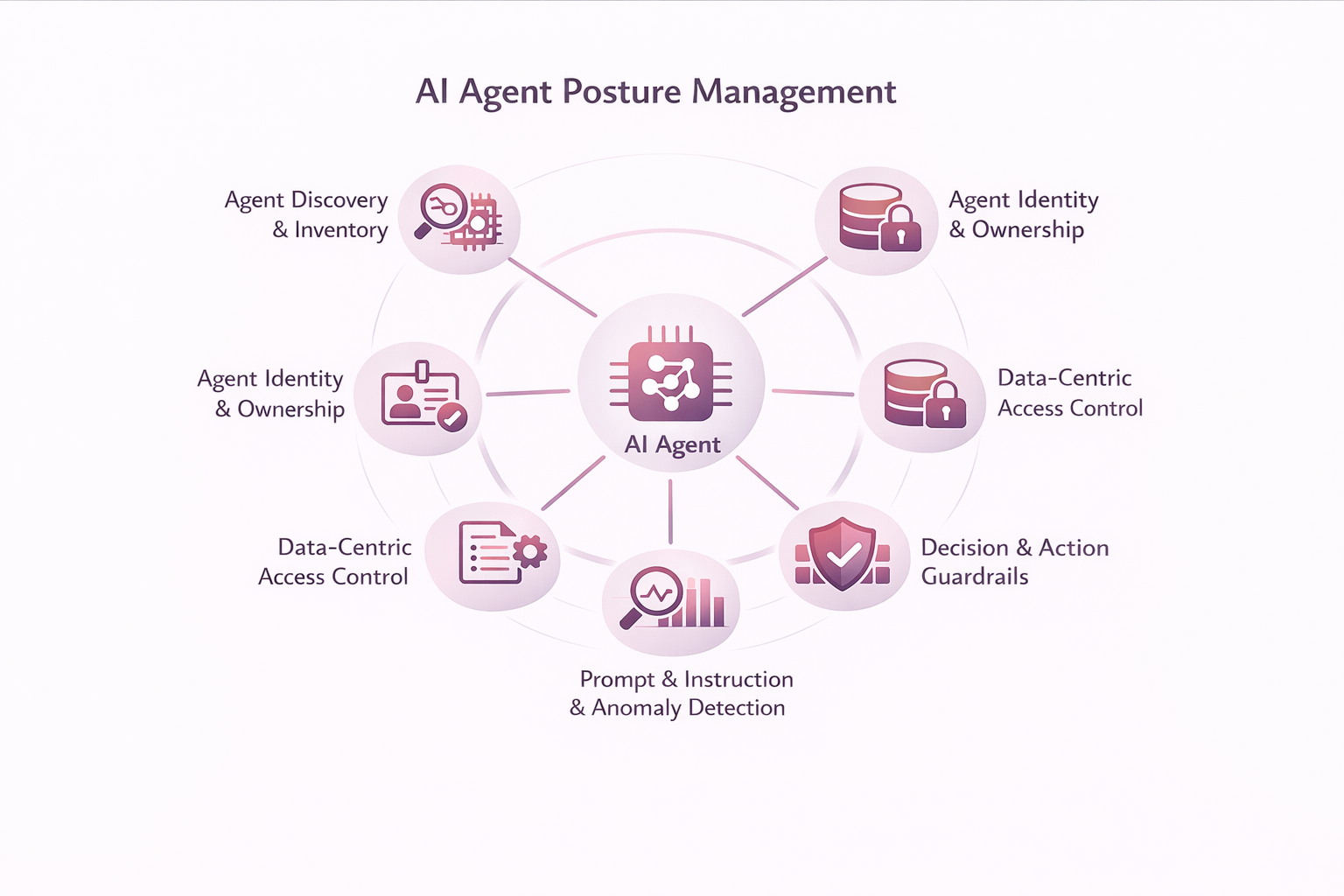

Kernfunktionen des KI-Agenten-Haltungsmanagements

Agentenfindung und -inventar

Die Verwaltung des KI-Agentenstatus beginnt mit Transparenz. Organisationen können nicht steuern, was sie nicht sehen, und den meisten Unternehmen fehlt ein vollständiges Verzeichnis der bereits in ihren Umgebungen eingesetzten KI-Agenten.

Agenten werden von Entwicklern erstellt, in SaaS-Plattformen eingebettet, über Automatisierungstools eingeführt oder durch KI-Funktionen in bestehenden Anwendungen aktiviert. Viele authentifizieren sich nicht-interaktiv und arbeiten kontinuierlich, wodurch sie außerhalb traditioneller Identitätsinventare liegen.

Agent Discovery schafft die Grundlage für das Haltungsmanagement durch die kontinuierliche Identifizierung und Inventarisierung von Agenten im gesamten Unternehmen, einschließlich:

- Entdeckung von KI-Agenten über Anwendungen, Cloud-Dienste und Automatisierungsframeworks hinweg

- Identifizierung nicht-menschlicher Identitäten wie Dienstprinzipale, OAuth-Apps und API-basierter Zugriff

- Korrelation der Agenten mit den Daten, auf die sie tatsächlich zugreifen und die sie verändern

- Erkennung von unkontrollierten, ruhenden oder überprivilegierte Agenten

Ohne Entdeckung agieren Agenten wie unsichtbare Insider. Mit Entdeckung lassen sich Haltungskontrollen gezielt und konsequent anwenden.

Agentenidentität und Eigentumsverhältnisse

Sobald Agenten entdeckt werden, müssen sie zugeordnet und zur Rechenschaft gezogen werden. Jeder KI-Agent sollte als erstklassiges Sicherheitsprinzip mit einem definierten Zweck und Aufgabenbereich behandelt werden.

Agentenidentität und Eigentumsverhältnisse gewährleisten Verantwortlichkeit durch:

- Jedem Agenten eine eindeutige, nachvollziehbare Identität zuweisen

- Festlegung eines eindeutigen Eigentümers und eines dokumentierten Geschäftszwecks

- Festlegung expliziter Bereichsgrenzen zwischen Systemen und Datendomänen

Identität allein reicht jedoch nicht aus. Wissen WHO Ein Agent erklärt nicht welche Daten es verwendet oder wie es sich im Laufe der Zeit verhält—deshalb muss die Identität mit dem Datenkontext verknüpft werden.

Agentenklassifizierung und Risikoprofilierung

Entdeckung und Identität allein begründen keine Risikoposition. Nicht alle Agenten bergen das gleiche Risiko, und Berechtigungen allein liefern ein unvollständiges Bild.

Agentenklassifizierung und Risikoprofilierung Bewertet Agenten anhand ihres beobachteten Verhaltens, einschließlich:

- Die Sensibilität und der regulatorische Charakter der abgerufenen Daten

- Welche Daten Agenten tatsächlich lesen, schreiben oder weitergeben

- Die Bandbreite des Zugangs über Systeme und Regionen hinweg

- Der Grad an Autonomie und Handlungsbefugnis des Agenten

Risikoprofile müssen kontinuierlich aktualisiert werden, da sich die Akteure weiterentwickeln. Indem die Klassifizierung auf realen Dateninteraktionen basiert, können Organisationen die Kontrollmaßnahmen dort konzentrieren, wo sie am wichtigsten sind.

Datenzentrierte Zugriffskontrolle

Systemweite Berechtigungen sind zu grob für autonome Agenten, die direkt mit sensiblen Informationen interagieren.

Die datenzentrierte Zugriffskontrolle erzwingt das Prinzip der minimalen Berechtigungen auf der Datenebene durch Folgendes:

- Einblick in den Zugriff der einzelnen Datenagenten

- Sensibilitätsbasierte Zugriffsentscheidungen auf Grundlage von Klassifizierung und Risiko

- Aufgaben- und zeitgebundener Zugriff anstelle von dauerhaften Berechtigungen

Ohne Kontrollen auf Datenebene können Organisationen eine übermäßige Offenlegung von Daten nicht verhindern – selbst wenn Identitäten und Berechtigungen auf dem Papier korrekt erscheinen.

Leitplanken für Entscheidungen und Handlungen

KI-Systeme beschränken sich nicht auf die Analyse – sie handeln. Mit zunehmender Autonomie wächst auch das potenzielle Ausmaß der Auswirkungen.

Entscheidungs- und Handlungsleitpläne definieren operative Grenzen, einschließlich:

- Explizite Beschränkungen für zulässige Aktionen

- Genehmigung durch den Menschen bei risikoreichen Entscheidungen

- Schutzmaßnahmen gegen irreversible Aktionen, wie z. B. Löschen oder Teilen

- Not-Aus-Schalter und Rollback-Pfade

Automatisierung ohne Leitplanken erhöht das Risiko anstatt die Effizienz zu steigern.

Schnelle und leitende Steuerung

Agentenhinweise und -anweisungen stellen eine wichtige Richtlinie dar, die das Verhalten direkt beeinflusst.

Prompt and Instruction Governance ermöglicht es Organisationen:

- Versions- und Prüfagentenanweisungen

- Sofortige Abweichung oder Manipulation erkennen

- Trennen Sie die Systemabsicht vom vom Benutzer bereitgestellten Kontext.

- Daten- und Compliance-Richtlinien im Rahmen der Agentenlogik durchsetzen

Ohne Einblick in die Anweisungen wird das Verhalten der Agenten unvorhersehbar und unsteuerbar.

Kontinuierliche Überwachung und Anomalieerkennung

Statische Steuerungsmethoden versagen in dynamischen Umgebungen. Das KI-Agenten-Positionsmanagement erfordert eine kontinuierliche Überwachung des Agentenverhaltens.

Kontinuierliche Überwachung und Anomalieerkennung bieten:

- Laufende Überwachung des Datenzugriffs und der Aktionen

- Verhaltens-Baseline pro Agent

- Erkennung von anomalem oder gegen Richtlinien verstoßendem Verhalten

- Korrelation mit Identität, Datenrisiko und Bedrohungssignalen

Dies ermöglicht ein frühzeitiges Eingreifen – bevor kleinere Abweichungen zu Vorfällen werden.

Die Risiken, die diese Disziplin verhindern soll

Ohne diese Fähigkeiten sind Organisationen einem wachsenden Risiko ausgesetzt: schleichender Rechteausweitung, unbemerktem Datenabfluss durch legitime Arbeitsabläufe, sofortigem Einschleusen von Daten und Verlust der Verantwortlichkeit bei Untersuchungen. Wenn Vorfälle auftreten, ist es weder ausreichend noch vertretbar, die Ergebnisse “der KI” zuzuschreiben.

Warum das Haltungsmanagement von KI-Agenten im Kern auf Daten basiert

Ein Großteil des Marktes konzentriert sich auf die Sicherung von Modellen oder die Verwaltung von Identitäten. Diese Ansätze sind notwendig, gehen aber nicht auf das wichtigste Risiko ein: die Interaktion autonomer Agenten mit Unternehmensdaten im Laufe der Zeit.

- Reine Identitätskontrollen können weder die Datensensibilität noch die tatsächliche Nutzung erkennen.

- Reine Modellsteuerung kann keine nachgelagerten Aktionen steuern.

Ohne Datenkontext wird die Körperhaltung abgeleitet, nicht erzwungen. Das Haltungsmanagement von KI-Agenten muss daher auf einem solchen Kontext basieren. datenzentrierte Sicherheitsplattform das Datensensibilität, Offenlegung und Aktivität in Echtzeit versteht.

Wie BigID eine datenorientierte Steuerung für KI-Agenten ermöglicht

BigID Unterstützt Organisationen bei der Erkennung und Klassifizierung sensibler Daten, dem Verständnis von Zugriff und Offenlegung, der Überwachung von Datenaktivitäten und der Durchsetzung richtlinienbasierter Korrekturmaßnahmen in großem Umfang. AI Agent Posture Management erweitert diese Funktionen auf autonome Akteure, die im gesamten Datenbestand agieren.

Anstatt zu fragen, ob ein KI-Modell “sicher” ist, sollten sich Organisationen eine praxisnähere Frage stellen: Bleiben unsere Daten unter Kontrolle, wenn KI eingesetzt wird? Dieser Paradigmenwechsel ermöglicht die Einführung von KI, ohne die Kontrolle zu verlieren.

Von KI-Governance bis zur Agentenhaltung

KI-Agenten sind bereits in großem Umfang in Unternehmensumgebungen im Einsatz. Organisationen, die sie lediglich als Werkzeuge betrachten, werden Schwierigkeiten haben, die Kontrolle zu behalten. Diejenigen hingegen, die Agenten als Identitäten behandeln – gesteuert durch datenzentrierte Kontrollen –, werden KI sicher und verantwortungsvoll skalieren können.

Die Verwaltung des KI-Agenten-Status ist keine Zukunftsmusik. Sie ist die nächste Evolutionsstufe der Datensicherheit, und eine frühzeitige Definition stellt sicher, dass sie sich nach Ihren Vorstellungen weiterentwickelt – und nicht erst nach einem Vorfall.

Möchten Sie mehr erfahren? Vereinbaren Sie ein Einzelgespräch mit einem unserer KI- und Datensicherheitsexperten.