Détection de modèles d'IA non autorisés

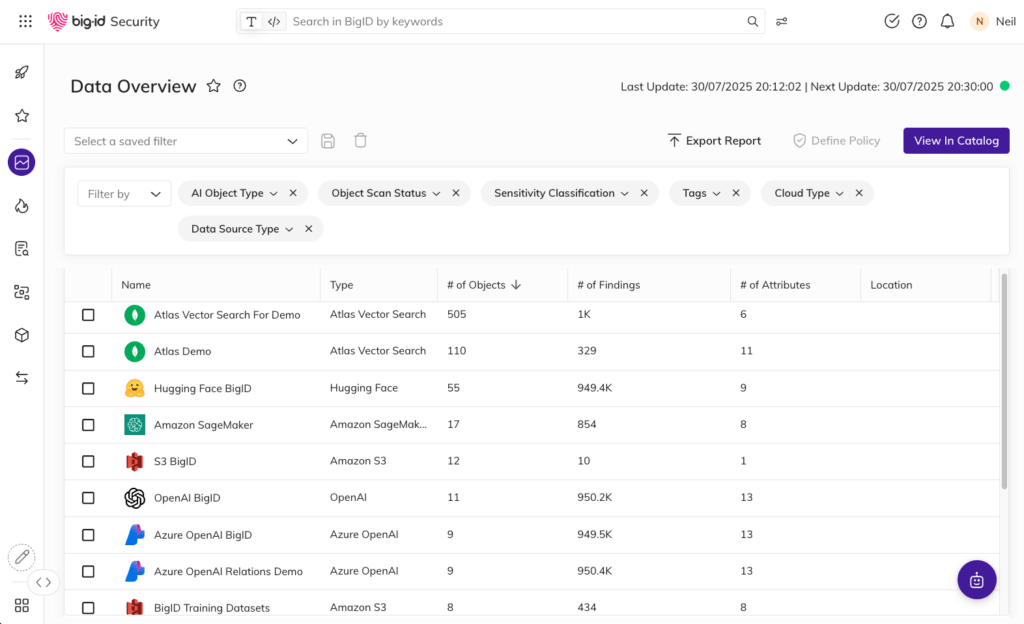

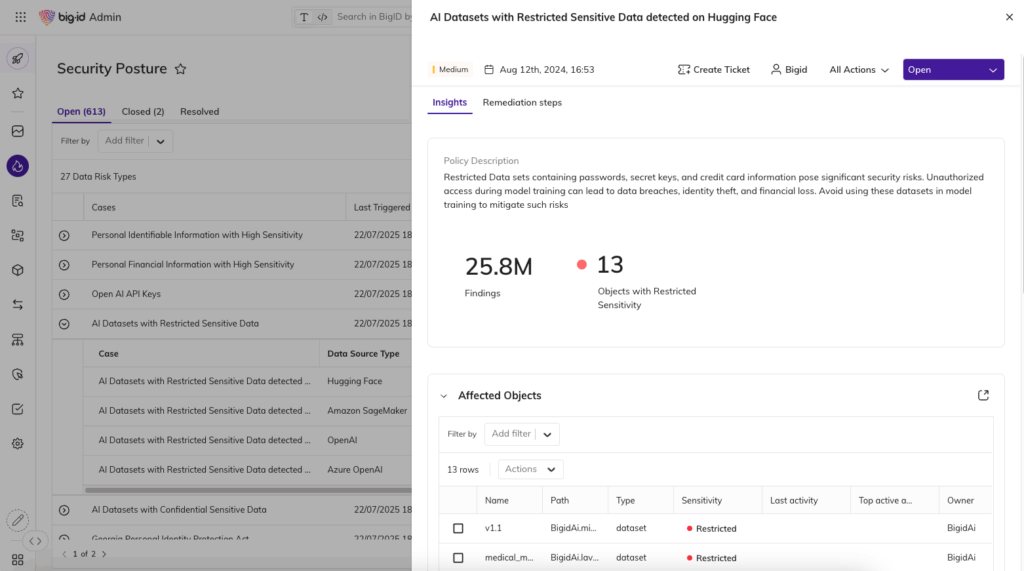

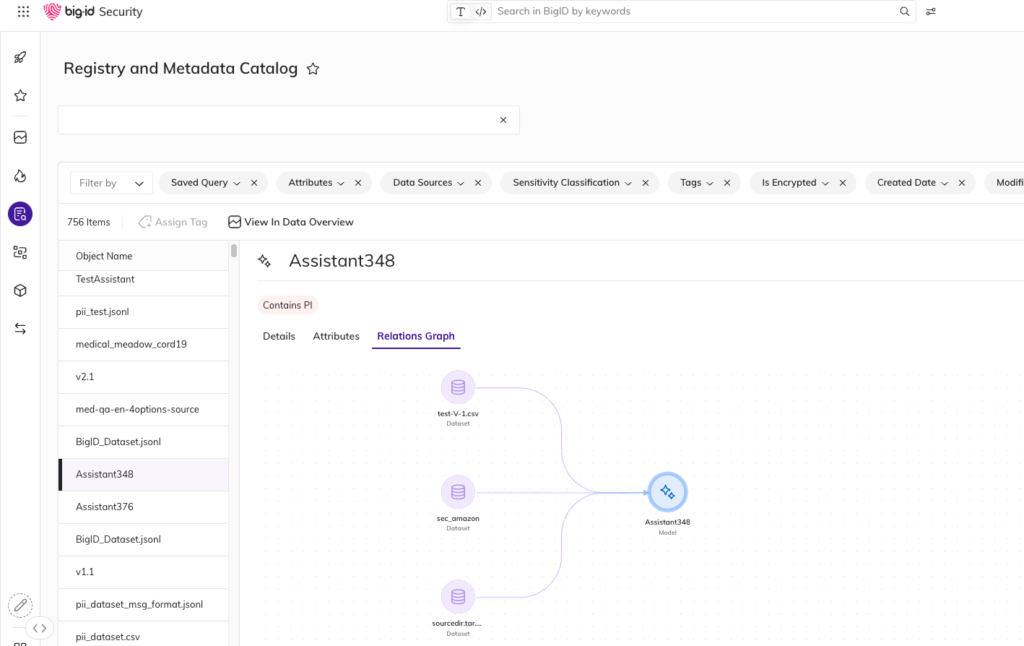

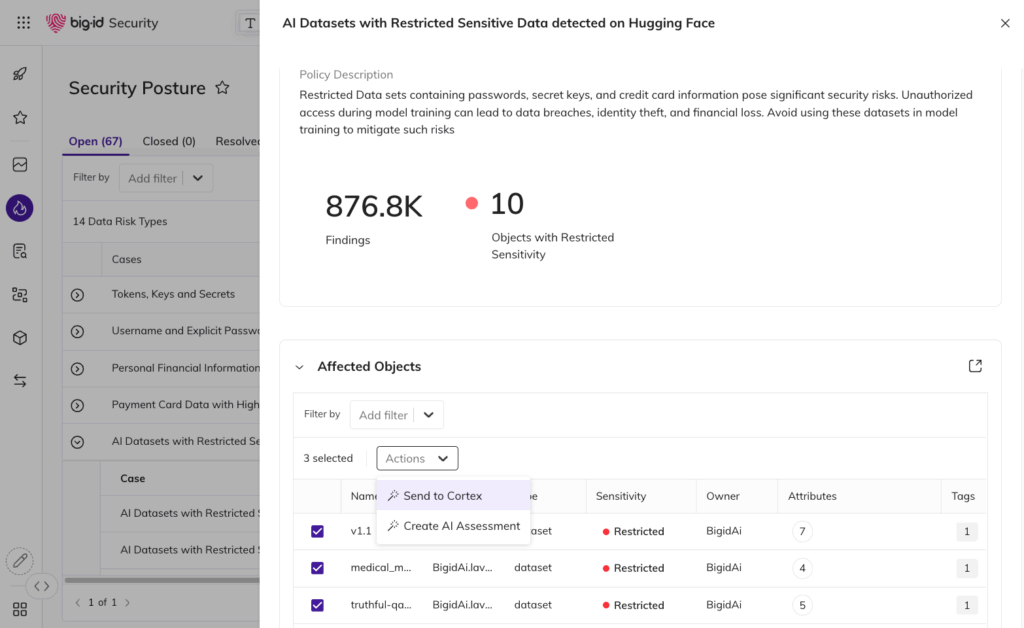

- Découvrez les modèles cachés, non gérés ou non enregistrés dans votre infrastructure

- Exposez l'IA fantôme avant qu'elle ne provoque des risques de sécurité, de conformité ou de fuite de données

- Gagnez en visibilité sur les projets d'IA expérimentaux ou non autorisés au sein des équipes