Detecção de modelo de IA não autorizado

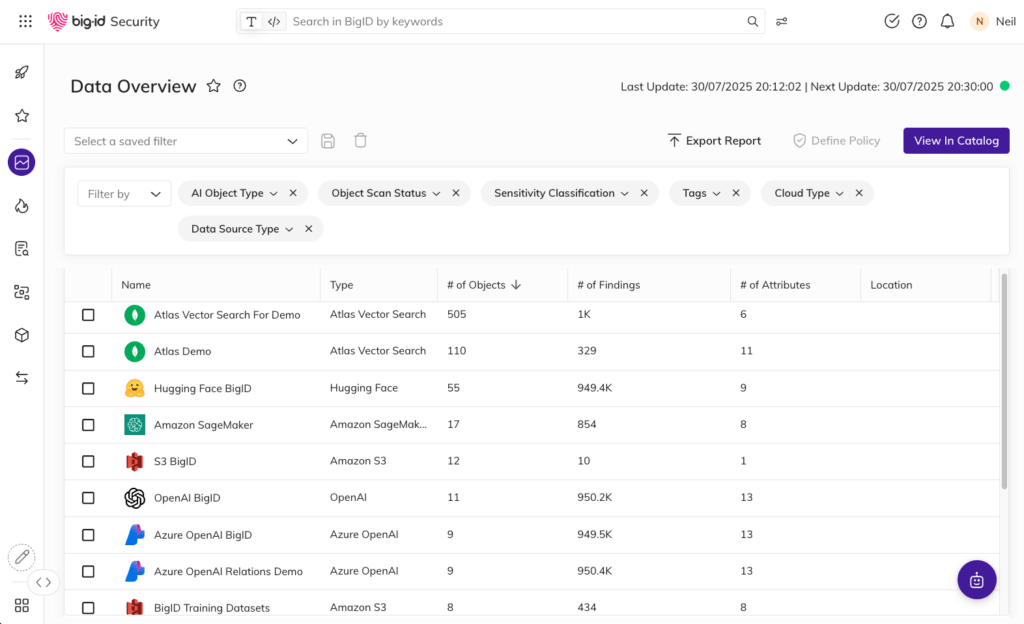

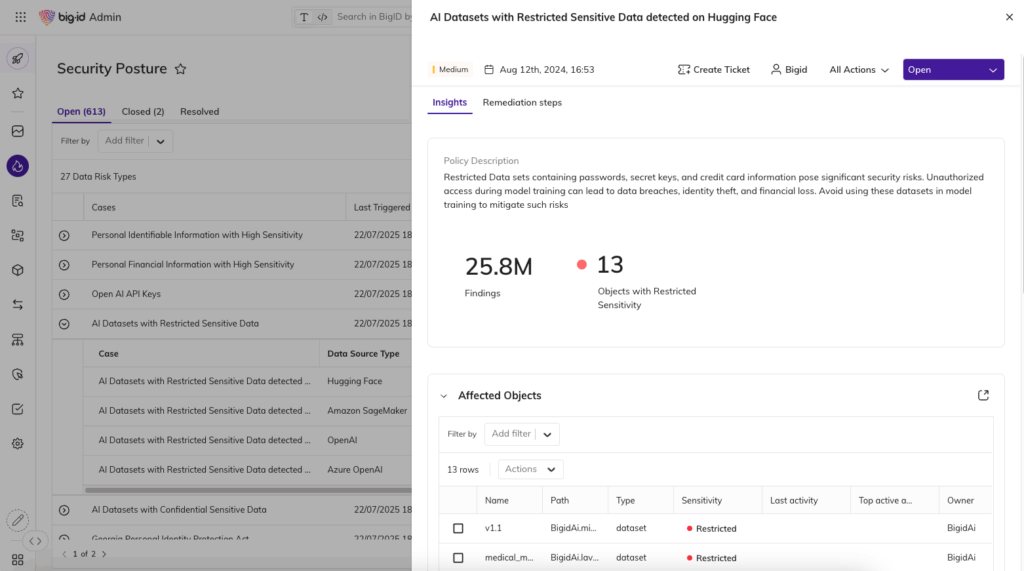

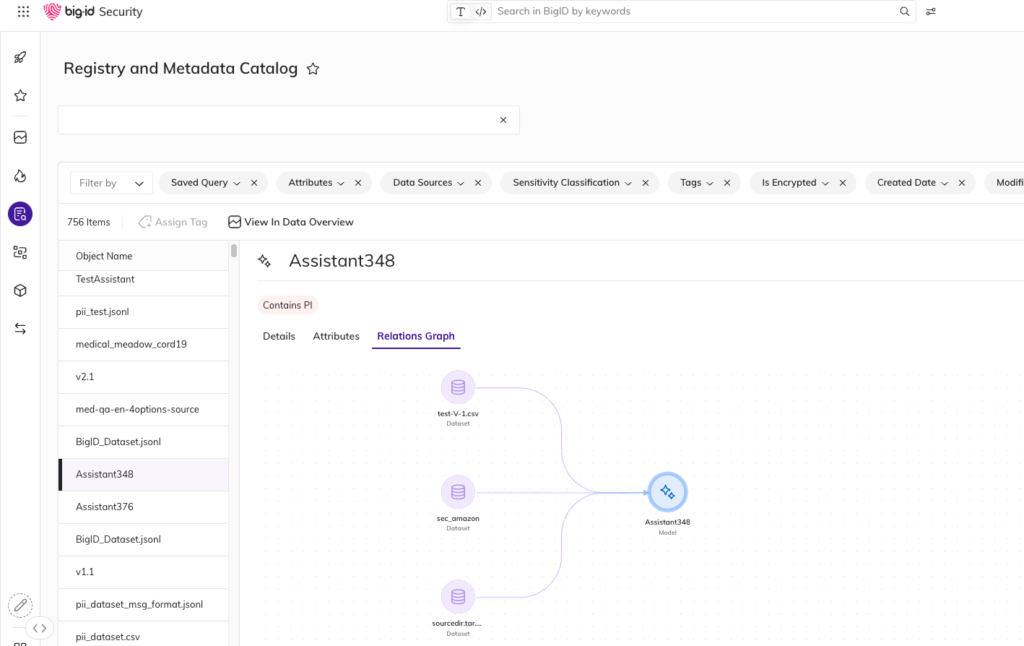

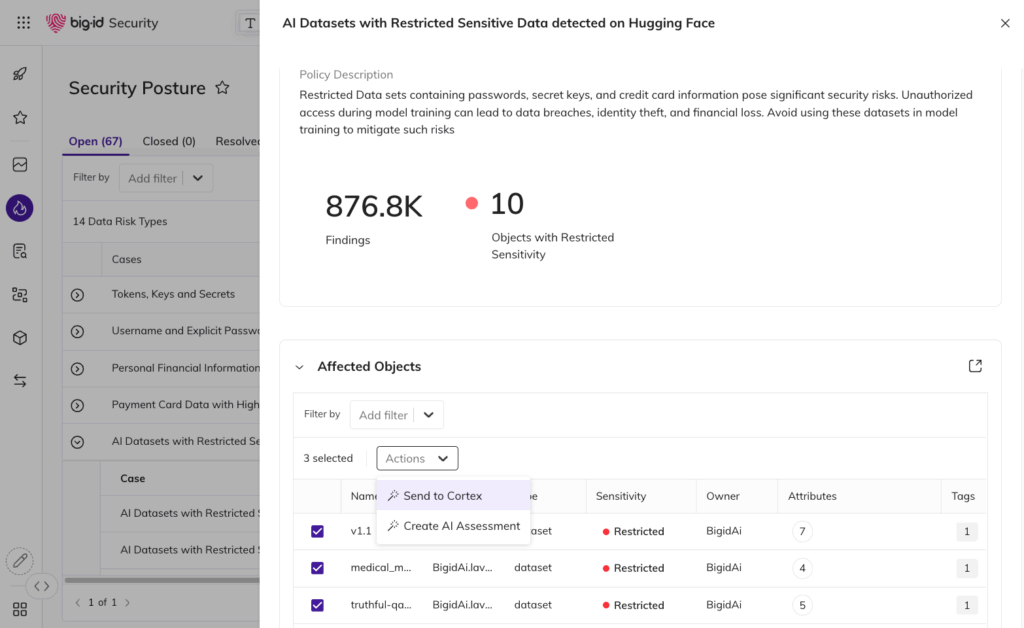

- Descubra modelos ocultos, não gerenciados ou não registrados em toda a sua infraestrutura.

- Exponha a IA oculta antes que ela cause riscos de segurança, conformidade ou vazamento de dados.

- Obtenha visibilidade de projetos de IA experimentais ou não autorizados em todas as equipes.