Visibilidad de datos de respuesta rápida y rápida

Los sistemas de IA generativa procesan entradas de lenguaje natural que pueden contener información confidencial.

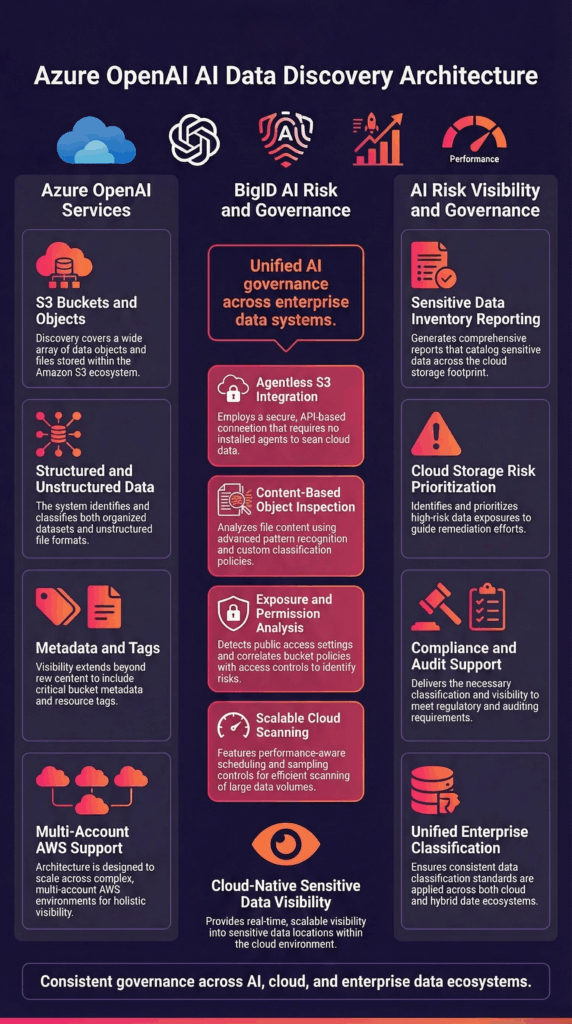

BigID permite a las organizaciones:

- Identificar datos regulados en indicaciones

- Detectar información confidencial en los resultados generados

- Monitorear patrones de uso de datos de IA

- Alinear las interacciones de IA con las políticas empresariales

Esto reduce el riesgo de divulgación no intencionada.