Los chatbots y las aplicaciones con IA se están convirtiendo en herramientas cotidianas en toda la empresa. Los empleados pegan avisos, comparten resultados y crean aplicaciones propias a una velocidad superior a la que los equipos de TI pueden gestionar. Sin embargo, esta rápida adopción conlleva un punto ciego crítico: fugas de datos sensibles que se esconden a simple vista.

Cada conversación, cada indicación y cada respuesta es una punto de exposición potencialDesde los números de Seguro Social en los chats de atención al cliente hasta los IBAN integrados en los resultados de las aplicaciones, el riesgo ya no es hipotético: está sucediendo hoy.

Cuando las conversaciones se convierten en un lastre

A medida que las organizaciones se inclinan por la IA, se enfrentan a un desafío creciente: cómo mantener las conversaciones seguras. Las herramientas de seguridad tradicionales no fueron diseñadas para monitorear ni proteger las indicaciones de la IA. No pueden detectar cuándo un empleado introduce datos financieros en un chatbot ni cuándo la respuesta de un modelo incluye accidentalmente información confidencial.

Esta falta de supervisión genera consecuencias reales:

- Fuga de datos que elude los controles existentes

- Violaciones de cumplimiento con GDPR, PCI, HIPAA, y más allá

- Pérdida de confianza del cliente Si se maneja mal la información privada

La realidad es que las indicaciones de IA son la nueva frontera de la exposición de datos. Sin visibilidad ni protección, las organizaciones corren el riesgo de que se filtren datos confidenciales.

Control de acceso para conversaciones GenAI

Ahí es donde entra BigID. Con Control de acceso a datos confidenciales en conversaciones de GenAI, las organizaciones finalmente pueden obtener visibilidad, control y barandillas en torno a datos sensibles con respecto a las aplicaciones de IA.

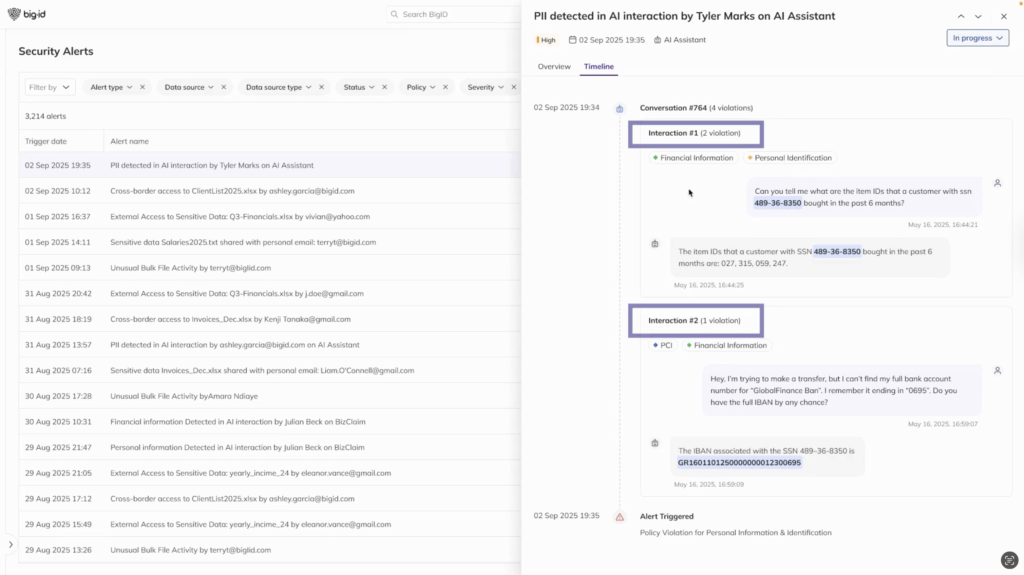

BigID continuamente detecta datos sensibles Tanto en las solicitudes como en las respuestas, desde identificadores personales hasta información financiera y más. BigID destaca las infracciones, muestra qué usuarios están involucrados y ofrece una cronología de las conversaciones de riesgo. Y lo que es más importante, va más allá de la detección con protección proactiva: censura información confidencial, oculta información de identificación personal (PII) y aplica controles de acceso sobre la marcha.

A diferencia de las herramientas de monitoreo tradicionales, BigID no solo señala los riesgos: ayuda a detenerlos, al tiempo que preserva el contexto y la funcionalidad de las interacciones de IA.

Resultados de IA que importan

- Visibilidad en las interacciones de IA – Vea dónde aparecen datos confidenciales en las indicaciones y respuestas.

- Prevenir la fuga de datos – Aplicar políticas de enmascaramiento y redacción que mantengan las conversaciones intactas pero seguras.

- Acelerar las investigaciones – Utilice alertas de violación y cronogramas para acelerar la respuesta ante incidentes.

- Fortalecer la adopción de IA – Generar confianza reduciendo el riesgo sin frenar la innovación.

Por qué ahora: Barandillas para la era de la IA

La adopción de la IA no se está ralentizando. De hecho, se está acelerando, al igual que los riesgos. Las organizaciones que implementan protección inmediata hoy pueden anticiparse a la exposición, la presión regulatoria y las crecientes amenazas a la seguridad de la IA. BigID ayuda a las empresas a adoptar la IA con confianza, haciendo que la protección de datos sea práctica, automática y diseñada para el futuro.

Da el siguiente paso

Descubra cómo funciona BigID Control de acceso para GenAI Puede ayudar a su organización a proteger conversaciones, prevenir fugas de datos y permitir la adopción segura de IA. Programe una reunión individual con uno de nuestros expertos en seguridad de IA hoy mismo.