Detectar y gestionar la IA en la sombra con BigID

En el panorama actual de IA en constante evolución, un riesgo oculto está creciendo: el aumento de IA de sombra—IA no autorizada, no aprobada y no gestionada que opera dentro de su organización. A medida que proliferan las herramientas de IA sofisticadas, incluidos modelos de código abierto o no aprobados como Búsqueda profundaDebe lograr una visibilidad completa. Esto no solo representa una ventaja competitiva, sino también un imperativo regulatorio. Ante la creciente preocupación por la privacidad de las herramientas de IA chinas y las amplias iniciativas regulatorias en la UE y California, necesita saber exactamente qué IA opera en su entorno.

Reconocer los peligros de los modelos de IA de código abierto o no administrados

Los modelos de IA de código abierto y no gestionados ofrecen un enorme potencial de innovación, pero también conllevan riesgos significativos. Estos sistemas "en la sombra" pueden eludir los protocolos de seguridad establecidos, lo que podría provocar la filtración de datos confidenciales o la creación de brechas de cumplimiento normativo. Por ejemplo, DeepSeek, un chatbot desarrollado en China que rivaliza con modelos de IA conocidos, ha ganado rápidamente popularidad, pero sus prácticas de privacidad son motivo de preocupación.

Informes recientes revelan que DeepSeek almacena datos de usuarios en servidores en China, lo que expone a su organización a riesgos de seguridad nacional y privacidad. Organismos reguladores de Italia y Australia ya han tomado medidas para bloquear o restringir el acceso a DeepSeek, alegando falta de transparencia en los datos y posible uso indebido según las leyes de ciberseguridad chinas. Análisis técnicos sugieren que sus mecanismos de inicio de sesión podrían estar vinculados a la infraestructura de telecomunicaciones estatal china, lo que aumenta el riesgo de intercambio encubierto de datos.

Cuando modelos no autorizados se infiltran en su entorno, operando fuera de los canales autorizados, sus vulnerabilidades ocultas en la cadena de suministro pueden volverse peligrosas. Los modelos de terceros no verificados podrían entrenarse con conjuntos de datos sesgados o incluso manipulados deliberadamente, lo que podría comprometer su seguridad y cumplimiento normativo.

Entienda lo que Shadow AI significa para usted

La IA en la sombra se refiere al uso no autorizado o no verificado de sistemas de inteligencia artificial dentro de su organización. Podría implementar estos sistemas sin el conocimiento del departamento de TI o fuera de los canales autorizados para satisfacer las necesidades inmediatas del negocio. Sin embargo, este uso "en la sombra" conlleva varios riesgos:

- Riesgos de cumplimiento: Es posible que los sistemas de IA no aprobados no cumplan con los requisitos reglamentarios, como los Ley de AI de la UE o las regulaciones emergentes de IA de California, que exigen documentación detallada y supervisión para cada caso de uso de IA.

- Fuga de datos: Los modelos de IA en la sombra podrían procesar datos confidenciales sin las protecciones adecuadas, exponiendo su información crítica.

- Vulnerabilidades de seguridad: Sin una supervisión adecuada, es posible que se pierdan parches de seguridad críticos y evaluaciones de riesgos, allanando el camino para ciberataques.

En esencia, Shadow AI representa una amenaza oculta que puede comprometer su eficiencia operativa y seguridad, además de ponerlo en desacuerdo con los estándares regulatorios globales en constante evolución.

Cómo BigID le ayuda a detectar y gestionar la IA en la sombra

La plataforma avanzada de inteligencia de datos de BigID le permite lograr una visibilidad completa de la IA y tomar medidas decisivas contra modelos de IA ocultos o no gestionados. Puede descubrir, mapear y gestionar todos los sistemas de IA de su organización, cumpliendo al mismo tiempo con los marcos regulatorios y de seguridad en constante evolución. Así es como lo hace con BigID:

1. Detectar archivos de modelo en fuentes de datos no estructurados

BigID escanea automáticamente sus repositorios de datos—incluidos buckets S3, almacenes de archivos y bases de datos— para detectar archivos y binarios asociados con modelos de IA (p. ej., PyTorch, TensorFlow). Este proceso ayuda a identificar implementaciones que han omitido los canales de TI formales, lo que señala posibles casos de uso no autorizado de LLM.

2. Extraer correos electrónicos para comunicaciones de servicios de IA

BigID analiza sus sistemas de correo electrónico corporativos (Gmail, Outlook, etc.) en busca de mensajes de registro o notificaciones de uso relacionados con servicios externos de IA como DeepSeek, OpenAI, Claude, Gemini y otros. Al identificar estas comunicaciones, puede revelar casos en los que los empleados podrían estar utilizando herramientas no autorizadas, exponiendo potencialmente datos confidenciales o infringiendo políticas internas.

3. Escanear repositorios de códigos

BigID amplía su exploración Incorpora capacidades en sus repositorios de código. Analiza el código fuente en busca de claves API integradas o llamadas a servicios de IA externos. Este proceso le permite detectar integraciones no autorizadas y detectar posibles vulnerabilidades en la cadena de suministro. Obtendrá información sobre los conjuntos de datos utilizados y se asegurará de que no estén sesgados ni alterados.

4. Supervisar las implementaciones de plataformas de IA nativas

Para las organizaciones que utilizan plataformas públicas de IA (p. ej., Hugging Face, Azure AI, OpenAI, Google Cloud AI), BigID supervisa las implementaciones para clasificar y analizar los modelos subyacentes. Permite detectar datos confidenciales en conjuntos de entrenamiento, identificar modelos fraudulentos que eluden los canales de aprobación estándar y verificar continuamente la cadena de suministro y los conjuntos de datos de entrenamiento. Este proceso protege contra sesgos involuntarios y la contaminación de datos, a la vez que activa medidas de cumplimiento de políticas para el uso no conforme.

5. Asignar conjuntos de datos y modelos a recursos de IA

BigID asigna cada conjunto de datos y modelo descubierto a su inventario de activos de IA, lo que garantiza el cumplimiento de mandatos como los de la Ley de IA de la UE. Este inventario completo le permite realizar un seguimiento de cada componente de IA, lo que facilita la gobernanza y proporciona la documentación necesaria que exigen las normativas globales.

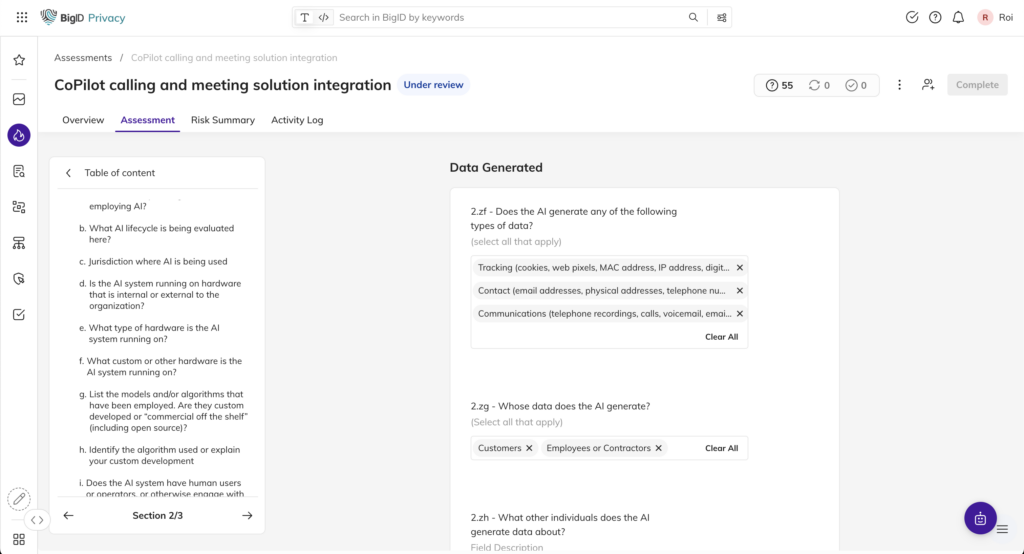

6. Iniciar y gestionar evaluaciones de riesgos de IA

BigID automatiza el proceso de evaluación de riesgos de IA clasificando cada activo de IA según las normas regulatorias. Mantiene un inventario de evaluación de riesgos actualizado, lo que le permite identificar rápidamente los riesgos asociados a cada modelo y cumplir con las regulaciones de IA en constante evolución. Una vez identificados los riesgos, BigID le ayuda a remediar el cumplimiento normativo y las vulnerabilidades de los datos. Puede depurar los conjuntos de datos de entrenamiento según las políticas de la organización, implementar controles de acceso estrictos y garantizar que solo persista el uso autorizado, mitigando así las posibles amenazas antes de que se intensifiquen.

7. Mapa de regulaciones y marcos de seguridad

BigID mapea continuamente sus implementaciones de IA contra marcos de seguridad o privacidad relevantes, como el Marco de gestión de riesgos de IA del NIST (AI RMF)y los requisitos regulatorios. Al revisar periódicamente qué controles podrían estar fallando, puede abordar las deficiencias de forma proactiva y mantener una gobernanza sólida de la IA.

Tome el control de su panorama de IA

En una era donde los entornos regulatorios se endurecen, desde la Ley de IA de la UE hasta la nueva legislación de California, es fundamental contar con una estrategia sólida para detectar y gestionar la IA en la sombra. Los sistemas de IA no gestionados pueden exponerlo a riesgos de cumplimiento normativo, seguridad y privacidad de datos, y socavar la confianza que ha generado con clientes y organismos reguladores.

BigID le proporciona visibilidad integral e inteligencia práctica para controlar la IA en la sombra e implementar una rigurosa gobernanza de la IA. Con nuestras herramientas avanzadas de detección, monitoreo y aplicación de políticas, usted sabe exactamente qué IA está operando en su entorno, lo que le permite gestionar los riesgos antes de que se conviertan en crisis.

¿Estás listo para tomar el control de tu panorama de IA?

Hable hoy con nuestros expertos en IA y descubra cómo las soluciones innovadoras de BigID pueden ayudarlo a detectar y gestionar Shadow AI, proteger su cadena de suministro contra datos de capacitación sesgados o contaminados y mantenerse a la vanguardia de los requisitos regulatorios globales.