O risco da IA não começa com o modelo, mas sim com os dados que o alimentam. À medida que dados sensíveis são incorporados em ferramentas de IA, fluxos de trabalho analíticos e serviços de terceiros, muitas equipes de segurança perdem a visibilidade assim que os dados saem do seu ambiente original. Para os líderes de segurança e dados, o desafio não é reconhecer o risco da IA, mas sim saber onde os dados sensíveis entram nos fluxos de trabalho de IA, como se movem depois disso e como implementar controles com antecedência suficiente para evitar a exposição.

Nesta sessão, abordaremos os seguintes tópicos:

- Formas comuns pelas quais dados sensíveis acabam em sistemas de IA, intencionalmente e não intencionalmente.

- Por que os controles de segurança e dados existentes têm dificuldade em manter a visibilidade à medida que o uso da IA aumenta?

- Como identificar e classificar dados de alto risco antes de serem usados para treinamento, ajuste fino ou inferência.

- Como a BigID ajuda as equipes a identificar sinais de risco precocemente e a aplicar os controles corretos automaticamente. Você sairá com uma abordagem clara para proteger dados confidenciais antes que eles cheguem aos modelos de IA e com uma estratégia mais sólida para garantir a segurança da IA à medida que sua adoção se acelera em 2026.

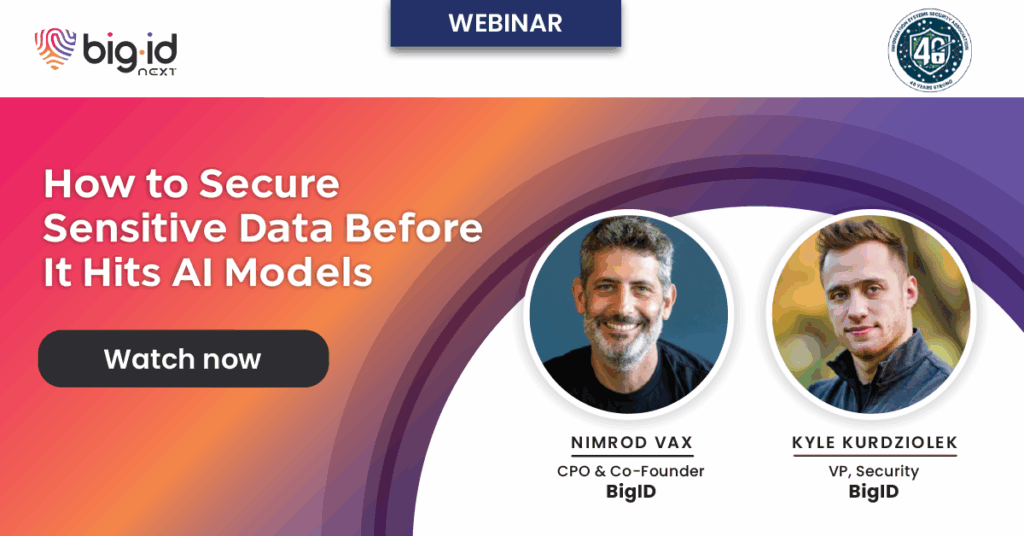

Palestrantes:

- Kyle Kurdziolek, Vice-Presidente de Segurança da BigID

- Nimrod Vax, CPO e cofundador da BigID