Introducción: La innovación en IA depende de la confianza

La IA está pasando rápidamente de la experimentación a la implementación a escala empresarial. Los modelos se entrenan, perfeccionan e implementan más rápido que nunca, a menudo utilizando grandes cantidades de datos personales y confidenciales. Pero a medida que los sistemas de IA se vuelven más potentes, también lo hace la... responsabilidad garantizar que el uso de datos respete las elecciones individuales y los compromisos éticos.

Para los líderes en materia de privacidad, esto crea un nuevo desafío: ¿cómo garantizar que el consentimiento del usuario se respete no solo en las políticas, sino también en la práctica, en todos los sistemas de IA y flujos de trabajo?

Hoy anunciamos Consent for AI, una nueva capacidad de BigID diseñada para ayudar a las organizaciones a operacionalizar el consentimiento en el uso de datos de IA y mantener la confianza a medida que se acelera la adopción de IA.

El problema: el consentimiento termina donde comienza la IA

La mayoría de las organizaciones tienen procesos maduros para recopilar y gestionar preferencias de consentimiento. Pero una vez que los datos personales entran en los procesos de IA (desde los datos de entrenamiento hasta la inferencia y las aplicaciones posteriores), las señales de consentimiento suelen perder visibilidad.

Los equipos de privacidad se plantean preguntas críticas:

- ¿Se ha retirado el consentimiento para los datos utilizados en este modelo?

- Son exclusiones voluntarias ¿Se refleja consistentemente en todos los sistemas de IA?

- ¿Podemos decir con seguridad que la IA no está utilizando datos personales cuando los usuarios han optado por no hacerlo?

Sin respuestas claras, las organizaciones enfrentan puntos ciegos que pueden socavar la confianza, los compromisos de IA responsable y la confianza en las iniciativas de IA.

Introducción del consentimiento para la IA

El consentimiento para la IA cierra la brecha entre la gestión del consentimiento y el uso de datos de IA.

Al conectar la inteligencia de consentimiento directamente con los sistemas de IA, los datos y el seguimiento de riesgos, BigID ayuda a los equipos de privacidad a detectar cuándo se retira el consentimiento y garantizar que las cancelaciones de consentimiento se detecten, rastreen y aborden en los entornos de IA.

En lugar de depender de revisiones manuales o documentación estática, Consent for AI proporciona visibilidad continua sobre cómo las opciones de consentimiento impactan el uso de datos de IA, lo que permite a los equipos actuar antes de que los problemas se conviertan en riesgos públicos, internos o de reputación.

Cómo funciona el consentimiento para la IA

El consentimiento para la IA amplía BigID Consentimiento universal plataforma con aplicación y supervisión basadas en IA, que permite a los equipos de privacidad gestionar el consentimiento donde realmente existe riesgo de IA.

Las capacidades clave incluyen:

- Aplicación del consentimiento con conocimiento de IA para detectar cuándo los datos personales aún pueden usarse en sistemas de IA después de retirar el consentimiento

- Manejo automatizado de la revocación del consentimiento mediante IA para eliminar flujos de trabajo manuales e inconsistencias

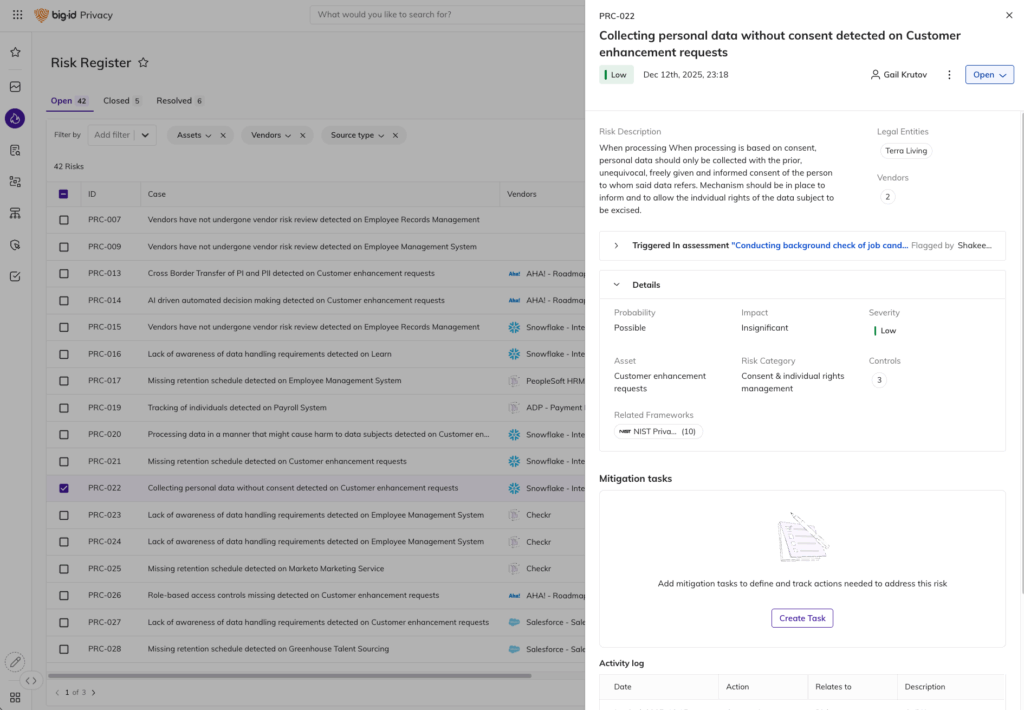

- Inteligencia integrada de consentimiento al riesgo que marca como riesgos las exclusiones voluntarias de IA no gestionadas

- Monitoreo continuo para el uso no autorizado de datos de IA

- Paneles de informes que brindan visibilidad lista para los ejecutivos sobre la postura de consentimiento de la IA y el estado de remediación

Por qué esto importa ahora

A medida que la IA se integra en las operaciones empresariales principales, aumentan las expectativas de transparencia y rendición de cuentas, tanto de clientes como de empleados, socios y juntas directivas. Incluso con la evolución de los enfoques regulatorios, la confianza sigue siendo innegociable.

El consentimiento para la IA ofrece a las organizaciones una forma de demostrar prácticas responsables de IA en la práctica, no solo en teoría. Al garantizar que los datos personales no se utilicen en sistemas de IA cuando los usuarios han optado por no hacerlo, los equipos de privacidad pueden impulsar la innovación sin sacrificar la confianza ni el control.

Creado para líderes en privacidad

El consentimiento para la IA está diseñado para Directores de privacidad y equipos de privacidad que necesitan más que documentación. Restaura el control, la visibilidad y la confianza al convertir el consentimiento en una parte operativa de la gobernanza de la IA, no en un registro desconectado.

Con Consent for AI, los equipos de privacidad pueden:

- Apoyar con confianza las iniciativas de IA

- Reducir el riesgo oculto de privacidad de la IA

- Demostrar un uso ético y transparente de los datos

- Reforzar la confianza con los clientes y las partes interesadas

Avanzando con la IA responsable

La IA seguirá evolucionando, al igual que las expectativas sobre el uso de los datos personales. El consentimiento para la IA ayuda a las organizaciones a mantenerse a la vanguardia al integrar el consentimiento en el uso de datos de IA, lo que garantiza que las prácticas responsables se adapten a la innovación.

Visite Consentimiento para la IA Para obtener más información o Programe una demostración 1:1 con nuestros expertos en privacidad y seguridad.