Inventario de activos de IA

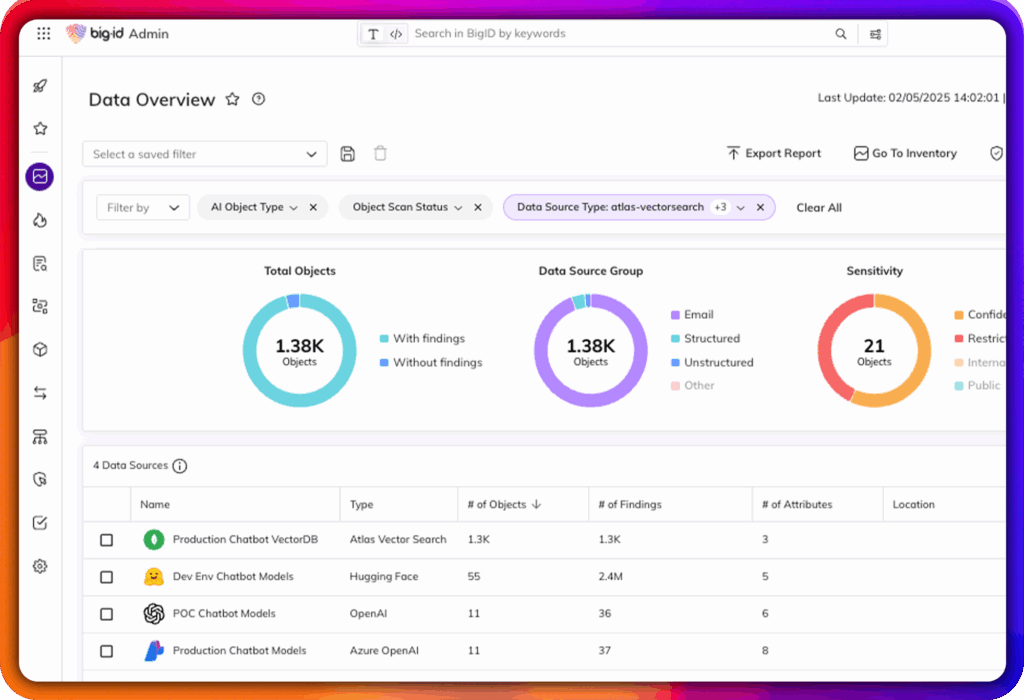

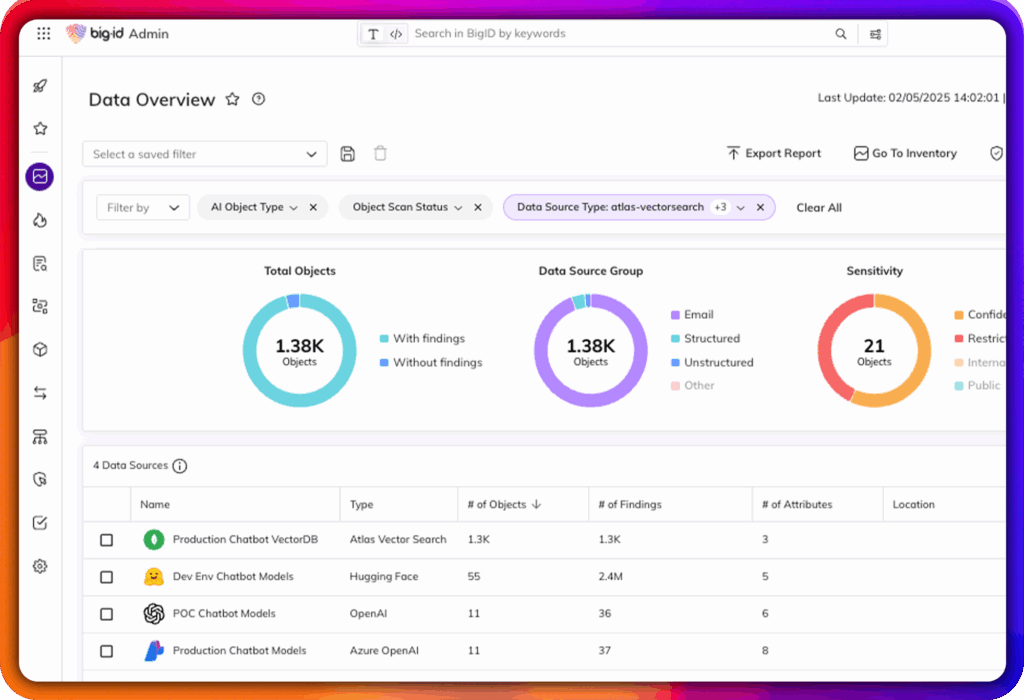

Descubra y catalogue automáticamente sus modelos de IA, conjuntos de entrenamiento, conjuntos de datos, copilotos y aplicaciones basadas en IA en entornos en la nube, SaaS y locales.

Detectar automáticamente modelos de IA, copilotos y herramientas de terceros en uso, sancionadas o no.

Mantener un inventario centralizado y permanentemente actualizado de los sistemas de IA y los datos asociados.

Saber dónde se despliegan los modelos, qué datos utilizan y cómo se aplican.

Definir e imponer el acceso basado en funciones a los datos de formación, avisos, resultados y modelos.

Identificar y mitigar el exceso de usuarios autorizados y el uso de IA en la sombra

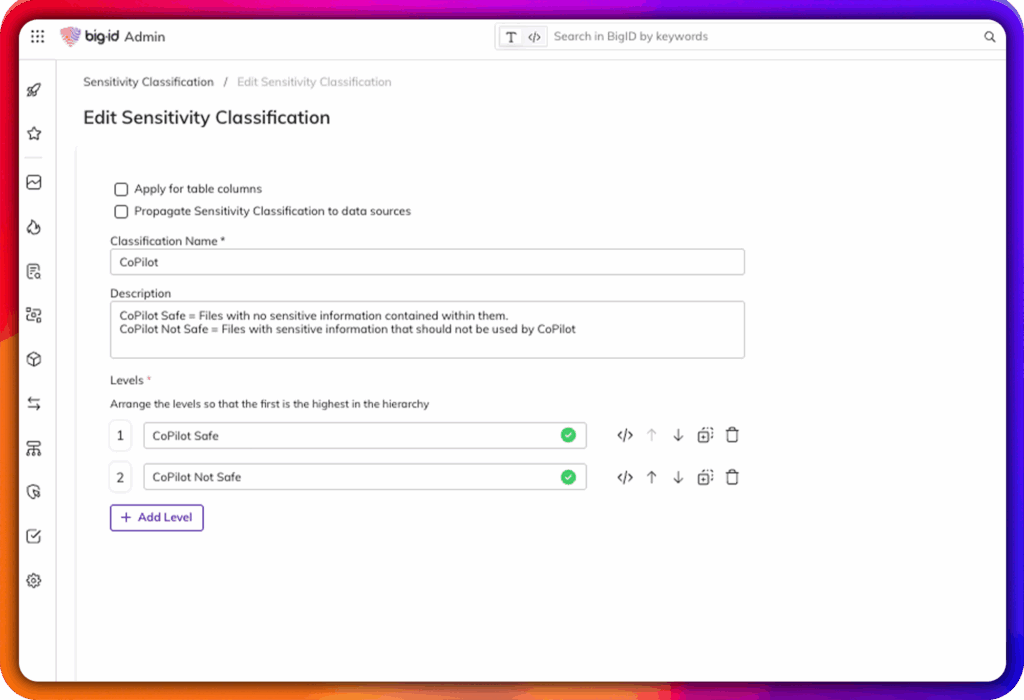

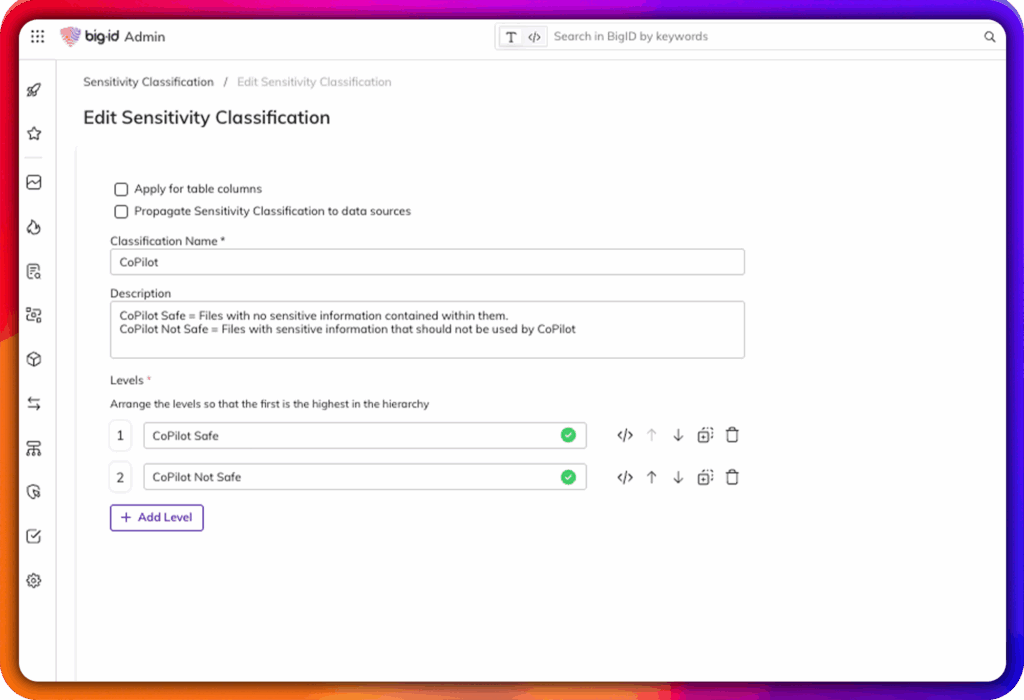

Limitar el acceso a la IA únicamente a los conjuntos de datos aprobados, conformes y adaptados a los fines perseguidos.

Aplicar controles de gobernanza desde la ingesta de datos hasta la implantación y el uso de modelos

Supervisar los riesgos específicos de la IA: sesgo, fuga de datos, infracciones de las políticas y uso no autorizado.

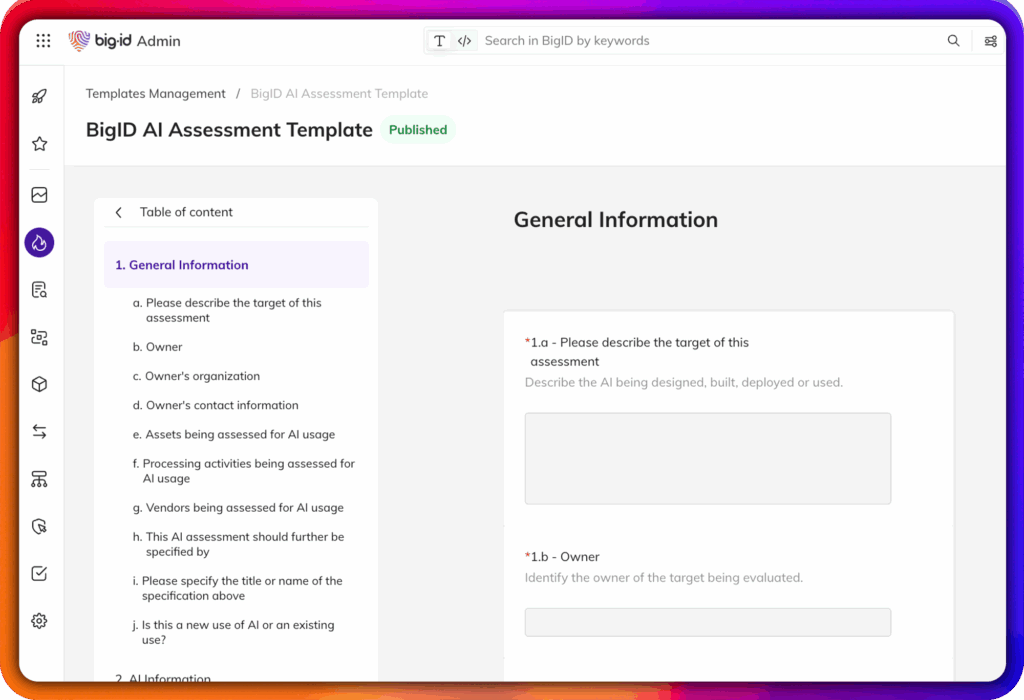

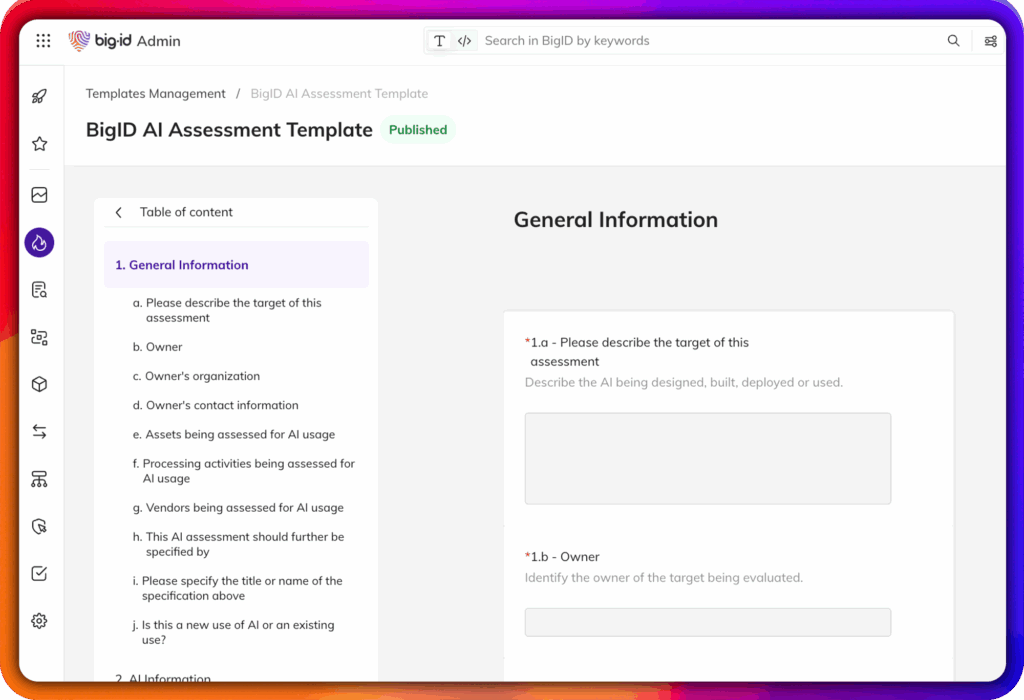

Automatice el cumplimiento de marcos globales como NIST AI RMF, la Ley de IA de la UE e ISO 42001.

BigID hace operativa la gestión de la confianza, el riesgo y la seguridad de la IA con capacidades reales, no vaporware:

Descubra y catalogue automáticamente sus modelos de IA, conjuntos de entrenamiento, conjuntos de datos, copilotos y aplicaciones basadas en IA en entornos en la nube, SaaS y locales.

Identifique y clasifique los datos sensibles, regulados o críticos que alimentan los modelos de IA, garantizando una IA responsable desde el principio.

Controle y supervise quién puede acceder a los modelos, los conjuntos de datos de formación y los canales de IA. Imponga los privilegios mínimos y la confianza cero en todos los entornos de IA.

Descubra actividades de IA no autorizadas, copilotos deshonestos y despliegues de modelos ocultos que podrían introducir riesgos o infringir las políticas.

Gobernar las políticas específicas de la IA en materia de privacidad, residencia de datos, seguridad y cumplimiento de la normativa, incluidos los marcos emergentes como la Ley de IA de la UE, NIST AI RMF e ISO/IEC 42001.

Detecte riesgos como datos de entrenamiento sobreexpuestos, accesos inseguros o conjuntos de datos propensos a sesgos, y tome medidas para solucionar los problemas antes de que se agraven.

Rastree el origen, la evolución y el uso de los datos y modelos de formación, lo que permite prácticas de IA transparentes y explicables para auditorías, cumplimiento y gobernanza.

Alerte y actúe en caso de infracciones de acceso, riesgos de IA en la sombra, incumplimientos de políticas y amenazas emergentes para sus entornos de IA.

Permita una innovación en IA fiable, responsable y resistente con AI TRiSM de BigID.